-

Køb standarder

-

Kundeservice

-

Log ind

14. maj 2025

Den 1. august 2024 trådte AI Act, den europæiske forordning, der har til formål at fremme ansvarlig udvikling og udbredelse af kunstig intelligens i EU, i kraft. Frem mod 2027 implementeres loven gradvist, hvilket skal skabe en fælles, europæisk juridisk ramme for udvikling, markedsføring og brug af AI. De virksomheder og organisationer, der anvender eller udvikler AI-systemer, som bliver karakteriseret som højrisiko, skal leve op til kravene i AI Act d. 2. august 2026.

Organisationer fra mere end 20 europæiske lande er i fuld gang med at udvikle de kommende harmoniserede standarder, der skal hjælpe organisationer med at leve op til kravene i AI Act. Organisationerne repræsenterer både små og store virksomheder, forskere, forbrugere og NGO’er, der i fællesskab mødes for at blive enige om indholdet i standarderne og sikre en høj kvalitet.

Standarderne er et solidt fundament til at opnå compliance, sikkerhed, udvikling og effektivitet i AI-systemer. De kommende standarder for AI skal bl.a. være med til at sikre en ansvarlig kobling mellem teknologi og menneske samt etisk brug af data og algoritmer.

De kommende standarder fokuserer primært på produkter, hvor AI er integreret, men der udvikles også et ledelsessystem for AI, baseret på eksisterende systemer som ISO 9001. Standarderne skal bl.a. give virksomheder retningslinjer for sikker og pålidelig brug af AI samt et system til at tjekke, om reglerne bliver overholdt.

- Det har været en kæmpe fordel, at vi har kørt parløb med EU-Kommissionen og deres arbejde med AI Act, samtidig med at vi har arbejdet med de europæiske AI-standarder. Det tætte samarbejde har givet en forhåndsindsigt i AI-lovgivningen og de mange parter i standardiseringsarbejdet har givet et godt netværk til at forstå udfordringer og fordele ved brug af AI i Europa, udtaler Grit Munk, digitaliseringspolitisk chef i IDA og med i det danske udvalg S-855, som repræsenterer Danmark i det europæiske arbejde.

Dansk Standard står i spidsen for den europæiske standardiseringsgruppe, CEN-CENELEC JTC 21, som udvikler standarderne, der skal hjælpe virksomheder med at leve op til lovgivningen.

- Standarder udgør et væsentligt værktøj for danske SMV'er i deres bestræbelser på at sikre overensstemmelse med AI-lovgivningen. De europæiske standarder tilbyder konkrete retningslinjer for design, implementering og løbende monitorering af AI-produkter gennem hele deres livscyklus. Vi ved fra andre sektorer, at det er en markant fordel for Danmark og danske virksomheder at lede arbejdet, da det giver en konkurrencefordel på det globale marked, udtaler Kim Skov Hilding, seniorkonsulent i Dansk Standard og ansvarlig for det danske udvalg for AI.

AI Act gælder for alle organisationer og virksomheder, der benytter AI-systemer.

AI Act kategoriserer kunstig intelligens efter fire risikoniveauer, som er retningsgivende for, hvilke forpligtelser udbydere og brugere af kunstig intelligens har. Dvs. jo højere risikoniveau, desto flere krav og forpligtelser er der. De fire risikoniveauer i AI Act er:

Derfor er behovet for viden om, hvordan man lever op til lovgivningen særligt stort. Virksomheder kan allerede nu begynde at forberede sig på de kommende krav, indtil standarderne udkommer i løbet af 2026.

Dansk Standard har sammen med en række danske aktører bl.a. udviklet specifikationer for AI med fokus på henholdsvis bias, gennemsigtighed og beslutningsstøttende anvendelse i offentlig sagsbehandling.

- Specifikationerne er tænkt som værktøjer til danske virksomheder og organisationer, der har brug for hjælp til deres arbejde med AI. Derudover er der en specifikation mere på vej, der forventes at udkomme i juni 2025, som har fokus på AI-færdigheder, hvilket også er et krav i AI Act, uddyber Kim Skov Hilding.

En anden mulighed er at se på standarden ISO/IEC 42001, som er et internationalt ledelsessystem for kunstig intelligens. ISO/IEC 42001 adresserer de unikke udfordringer, som AI udgør for en organisation, som fx etiske hensyn, gennemsigtighed og behovet for kontinuerlig læring. Den fastlægger en struktureret måde, hvorpå organisationer kan styre risici og muligheder forbundet med AI, så der skabes balance mellem innovation og styring. Dog har standarden sine begrænsninger ift. at leve op til kravene AI Act:

- Organisationer kan ikke anvende ISO/IEC 42001 til at leve op til AI Act, men standarden kan hjælpe med at få styr på dokumentation omkring AI, hvilket kan være en fordel, når de kommende AI-standarder skal implementeres. ISO 42001 er desuden anerkendt internationalt, hvilket er en fordel, hvis man sælger ydelser og produkter på det globale marked, slutter Kim Skov Hilding.

Standarderne kommer i offentlig høring, inden de bliver udgivet, og her kan alle læse med og komme med input til de endelige versioner. Det betyder også, at alle her kan få en idé om, hvad de endelige standarder kommer til at indeholde. Efter planen kommer standarderne i høring i slutningen af 2025 eller starten af 2026.

Du kan holde dig opdateret om AI Act og de kommende standarder gennem Dansk Standards nyhedsbrev.

Det er stadig muligt at bidrage til udviklingen af de kommende internationale standarder. Er du interesseret i dette, kan du blive medlem af Dansk Standards udvalg for kunstig intelligens. Læs mere om udvalget her .

Risikostyring og cybersikkerhed får stor betydning for arbejdet med AI-systemer – særligt for højrisiko AI-systemer. De to centrale europæiske AI-standarder er nu sendt i offentlig høring, så alle interesserede kan læse med og komme med input.

Den nye politiske aftale om EU’s såkaldte Digital Omnibus for AI vil give virksomheder omkring 1,5 år mere til at leve op til visse krav i AI-forordningen.

AI har potentiale til at forbedre det danske sundhedsvæsen. Men teknologien rummer både muligheder og udfordringer, og her kan standarder hjælpe.

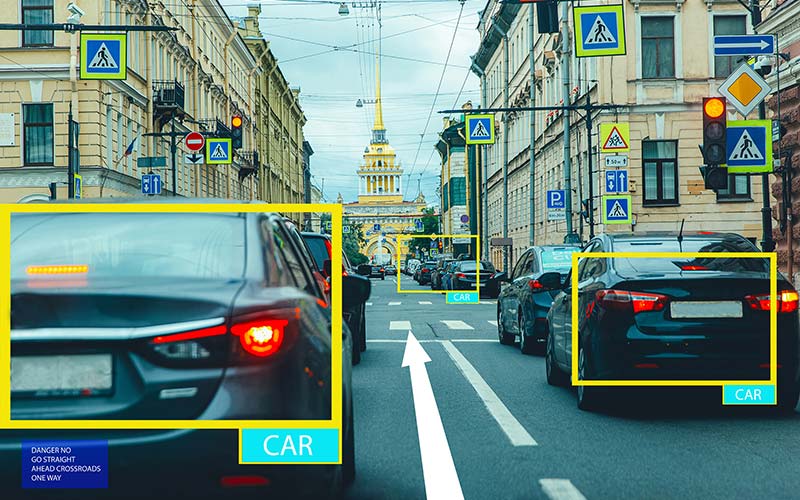

Den europæiske standard for AI-systemer med computer vision er netop sendt i offentlig høring. Standarden sætter krav til, hvordan man må analysere og fortolke billede- og videomateriale.